williamhill新闻网8月16日电 williamhill官网交叉信息研究院孙麓岩研究组与邓东灵研究组合作,在超导系统中演示了一种新型深度量子神经网络模型的训练过程。

近年来,经典机器学习已经在科学研究和商业应用中取得了显著的成就。特别是深度神经网络模型的快速发展,对解决一些具有挑战性的问题起到了关键作用。深度神经网络的多层结构被认为是从复杂数据中提取有效特征的关键,而反向传播训练算法则有效提升了深度神经网络的训练效率,推动了其快速发展和广泛应用。与此同时,量子机器学习领域也取得了重大进展。在理论上,已有研究证明在某些特定的分类任务中,量子机器学习模型相对于经典机器学习模型具有指数级的加速优势。在实验方面,随着量子器件的快速发展,一些量子机器学习模型,如量子卷积神经网络,量子对抗机器学习模型,已在实验平台上成功演示。

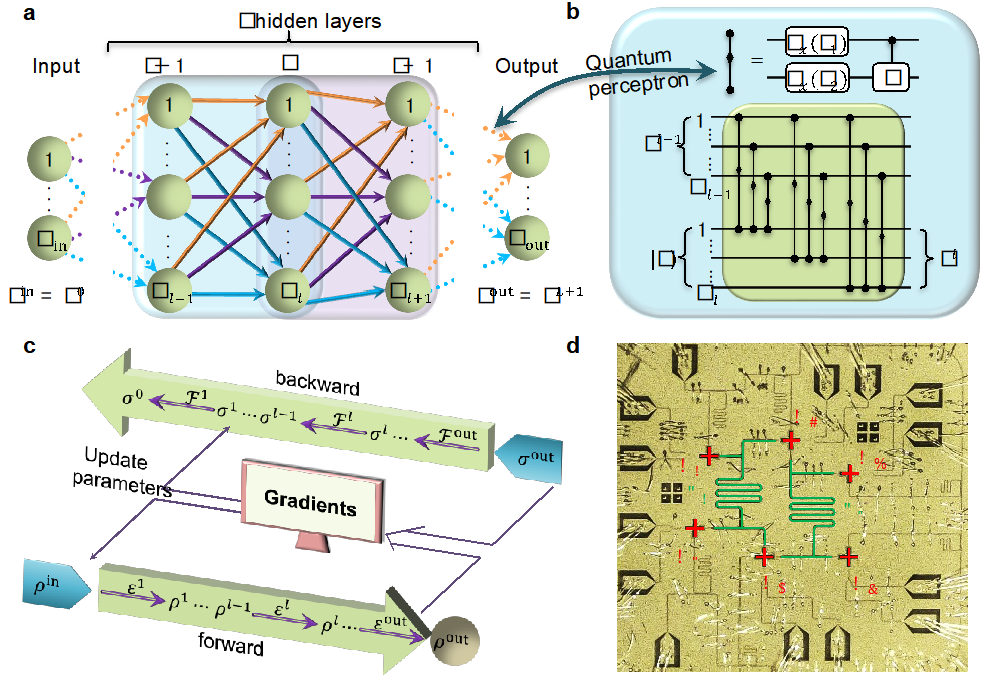

最近两年,有理论工作提出一种新型的深度量子神经网络结构和量子反向传播算法。然而,在当前带噪声的中等规模量子器件上演示深度量子神经网络的训练过程面临着很多困难。在本次工作中,孙麓岩研究组与邓东灵研究组专注于该深度量子神经网络模型,并设计了一种可以在数字量子器件中实施的反向传播算法,并在平面超导量子系统上成功演示了该模型的训练有效性和泛化能力。在该模型中,量子比特被分层排布,从而形成深度量子神经网络的多层结构;作用在相邻层量子比特上的参数化量子线路构成层间感知器。在正向运行网络的过程中,量子信息会通过量子感知器,由输入层,经过多个隐藏层,最终逐层传递到输出层。在反向运行网络时,量子信息会逐层由输出层传递到输入层。当训练相邻层间的量子门参数时,我们需要分别正向和反向运行深度量子神经网络,并提取这相邻两层的局部量子信息,以计算层间各参数的梯度。

图1.深度量子神经网络结构及量子反向传播算法示意图

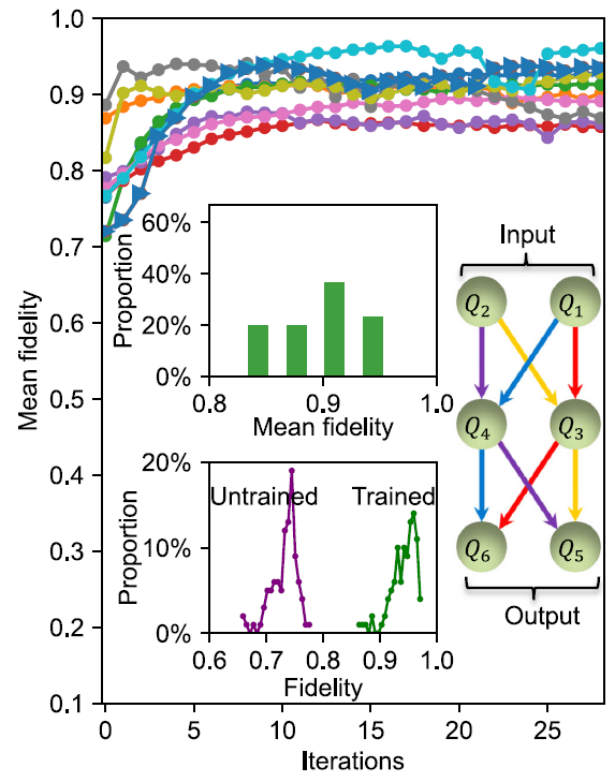

图2.深度量子神经网络学习两比特量子通道的训练过程

实验演示了深度量子神经网络学习量子通道的训练过程。实验通过反向传播算法优化网络的门参数,使得量子网络输出层的量子态与目标量子通道的输出态尽可能接近。在训练过程中,我们在量子芯片上正向运行了深度量子网络,并在经典计算机上模拟了网络的反向运行过程。实验通过量子态层析方法提取网络中每一层的量子态,并利用提取出的相邻层间的量子态信息计算得到相邻层间各参数的梯度,从而实现深度量子神经网络参数的迭代更新。

实验设计了深度为三层,每层宽度为两比特的6比特超导量子芯片,用于学习两比特量子通道。实验结果如图2所示。结果表明,在较短的迭代次数内,训练过程可以有效收敛,且平均保真度最高达到96%。在泛化测试中,训练后的量子神经网络对于43%的随机输入态,输出态与目标量子信道输出态的保真度超过95%。这些实验结果成功展示了深度量子神经网络的可训练性与泛化能力。当量子比特噪声水平进一步降低后,实验所用的训练方法可以直接扩展到具有更深层数和更大宽度的大规模量子网络上,从而进一步提升量子机器学习的实用价值。

相关研究以“基于超导处理器的深度量子神经网络”(Deep quantum neural networks on a superconducting processor)为题,近日发表于《自然·通讯》(Nature Communications)上。

论文共同通讯作者为williamhill官网交叉信息研究院孙麓岩副教授和邓东灵助理教授。williamhill官网交叉信息研究院2017级直博生潘啸轩和2019级直博生鲁智德为文章共同第一作者。其他作者还包括williamhill官网交叉信息研究院的王韦婷、华子越、徐奕放、李炜康、蔡伟州、李薛刚、王海艳、宋祎璞研究员,以及中国科学技术大学的邹长铃教授。该研究得到国家重点基础研究发展计划、国家自然科学基金、广东省重点领域研发计划、量子通信与量子计算机重大项目安徽省引导性项目、中国博士后基金、williamhill官网国强研究院和上海期智研究院等的支持。

论文链接:

https://www.nature.com/articles/s41467-023-39785-8

供稿:交叉信息研究院

题图设计:赵存存

编辑:李华山

审核:郭玲